有道无术,术尚可求,有术无道,止于术。

资料整理来自Nacos架构与原理电子书

下载地址:https://developer.aliyun.com/ebook/36?spm=a2c6h.20345107.ebook-index.18.152c2984fsi5ST

文章目录

- Nacos通信通道

-

- Nacos 长链接

-

- ⼀、现状背景

- 二、场景分析

- 三、长链接核心诉求

- 四、长链接选型对比

- 五、基于长链接的⼀致性模型

- 六、核心模型组件设计

Nacos通信通道

Nacos 长链接

⼀、现状背景

Nacos 1.x 版本 Config/Naming 模块各自的推送通道都是按照自己的设计模型来实现的。

配置和服务器模块的数据推送通道不统⼀,http 短连接性能压力巨大,未来 Nacos 需要构建能够 同时支持配置以及服务的长链接通道,以标准的通信模型重构推送通道。

二、场景分析

1. 配置

配置对连接的场景诉求分析

2. 服务

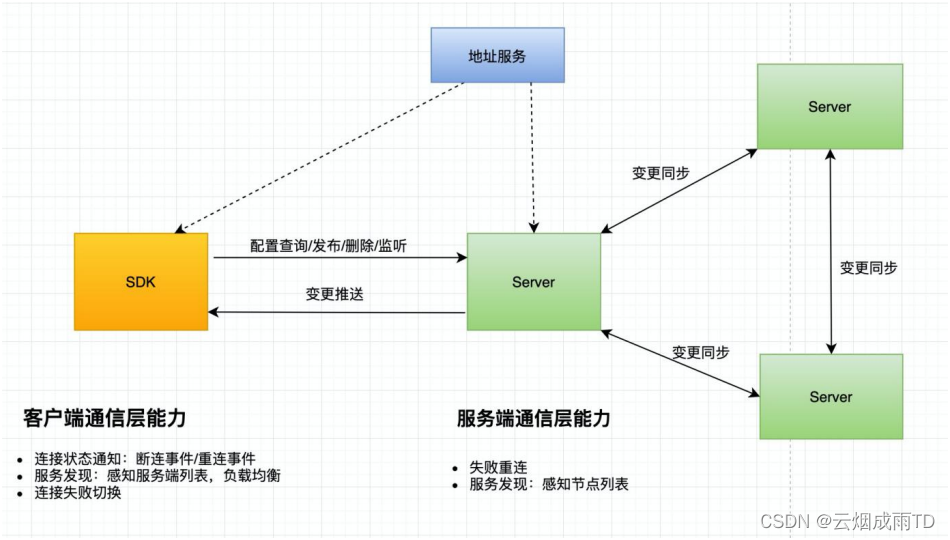

SDK 和 Server 之间 :

- 客户端 SDK 需要感知服务节点列表,并按照某种策略选择其中⼀个节点进行连接;底层连接 断开时,需要进行切换 Server 进行重连。

- 客户端基于当前可用的长链接进行配置的查询,发布,删除,监听,取消监听等配置领域的 R PC 语意接口通信。

- 感知配置变更消息,需要将配置变更消息通知推送当前监听的客户端;网络不稳定时,客户端 接收失败,需要支持重推,并告警。

- 感知客户端连接断开事件,将连接注销,并且清空连接对应的上下文,比如监听信息上下文清 理。

Server 之间通信 :

- 单个 Server 需要获取到集群的所有 Server 间的列表,并且为每⼀个 Server 创建独立的长链 接;连接断开时,需要进行重连,服务端列表发生变更时,需要创建新节点的长链接,销毁下 线的节点长链接。

- Server 间需要进行数据同步,包括配置变更信息同步,当前连接数信息,系统负载信息同步, 负载调节信息同步等。

三、长链接核心诉求

1. 功能性诉求

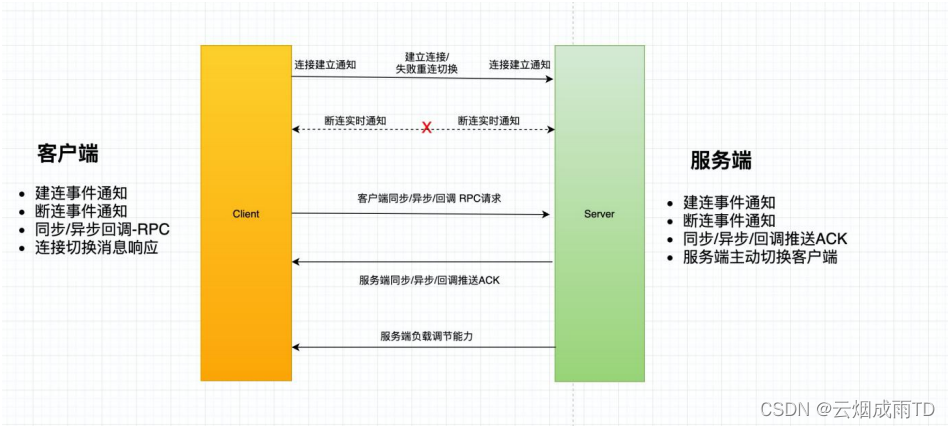

客户端:

- 连接生命周期实时感知能力,包括连接建立,连接断开事件。

- 客户端调用服务端支持同步阻塞,异步 Future,异步 CallBack 三种模式。

- 底层连接自动切换能力。 响应服务端连接重置消息进行连接切换。

- 选址/服务发现。

服务端:

- 连接生命周期实时感知能力,包括连接建立,连接断开事件。

- 服务端往客户端主动进行数据推送,需要客户端进行 Ack 返回以支持可靠推送,并且需要进行失 败重试。

- 服务端主动推送负载调节能力。

2. 性能要求

性能方面,需要能够满足阿里的生产环境可用性要求,能够支持百万级的长链接规模及请求量和推 送量,并且要保证足够稳定。

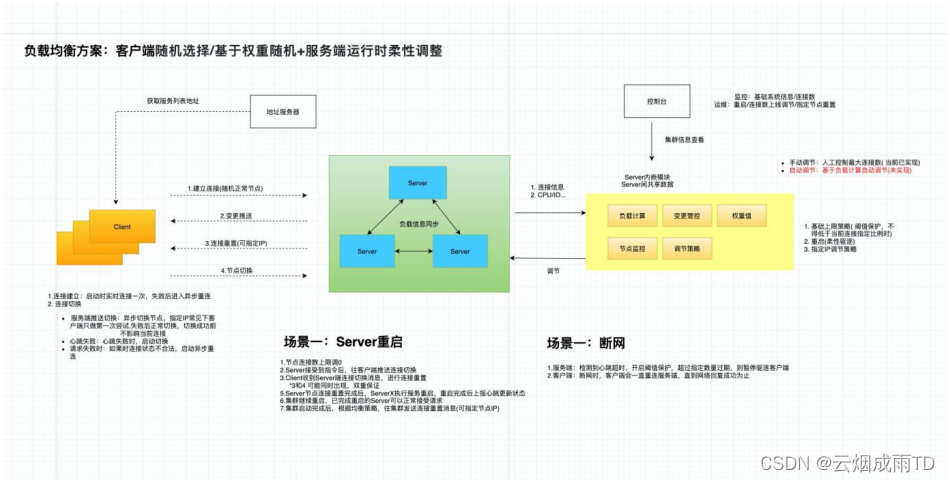

3. 负载均衡

常见的负载均衡策略:随机,hash,轮询,权重,最小连接数,最快响应速度等

短连接和长链接负载均衡的异同:在短连接中,因为连接快速建立销毁,“随机,hash,轮询, 权重”四种方式大致能够保持整体是均衡的,服务端重启也不会影响整体均衡,其中“最小连接 数,最快响应速度”是有状态的算法,因为数据延时容易造成堆积效应;长连接因为建立连接后, 如果没有异常情况出现,连接会⼀直保持,断连后需要重新选择⼀个新的服务节点,当出现服务节点发布重启后,最终连接会出现不均衡的情况出现,“随机,轮询,权重”的策略在客户端重 连切换时可以使用,“最小连接数,最快响应速度”和短连接⼀样也会出现数据延时造成堆积效 应。

长连接和短连接的⼀个主要差别在于在整体连接稳定时,服务端需要⼀个 rebalance 的机制, 将集群视角的连接数重新洗牌分配,趋向另外⼀种稳态 。

客户端随机+服务端柔性调整核心的策略是客户端+服务端双向调节策略,客户端随机选择+服务端运行时柔性调整。

客户端随机:客户端在启动时获取服务列表,按照随机规则进行节点选择,逻辑比较简单,整体能够保持随机。

服务端柔性调整: (当前实现版本)人工管控方案:集群视角的系统负载控制台,提供连接数,负载等视图(扩展新增 连接数,负载,CPU 等信息,集群间 report 同步),实现人工调节每个 Server 节点的连接数, 人工触发 reblance,人工削峰填谷。

- 提供集群视角的负载控制台:展示 总节点数量,总长链接数量,平均数量,系统负载信息。

- 每个节点的地址,长链接数量,与平均数量的差值,正负值。

- 对高于平均值的节点进行数量调控,设置数量上限(临时和持久化),并可指定服务节点进行切 换。

- (未来终态版本)自动化管控方案:基于每个 server 间连接数及负载自动计算节点合理连接数,自 动触发 reblance,自动削峰填谷。实现周期较长,比较依赖算法准确性。

4. 连接⽣命周期

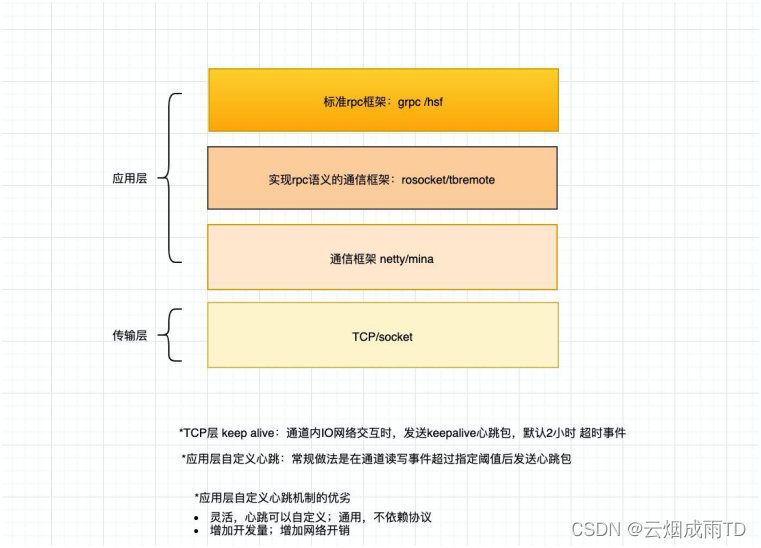

心跳保活机制

参考:

- 理解 TCP Keepalive: https://blog.csdn.net/chrisnotfound/article/details/80111559

- grpc keepalive :https://blog.csdn.net/zhaominpro/article/details/103127023

- netty 的心跳检测:https://www.cnblogs.com/rickiyang/p/12792120.html

我们需要什么

-

低成本快速感知:客户端需要在服务端不可用时尽快地切换到新的服务节点,降低不可用时间, 并且能够感知底层连接切换事件,重置上下文;服务端需要在客户端断开连接时剔除客户端连接 对应的上下文,包括配置监听,服务订阅上下文,并且处理客户端连接对应的实例上下线。

-

客户端正常重启:客户端主动关闭连接,服务端实时感知

-

服务端正常重启 : 服务端主动关闭连接,客户端实时感知

-

防抖: 网络短暂不可用: 客户端需要能接受短暂网络抖动,需要⼀定重试机制,防止集群抖动,超过 阈值后需要自动切换 server,但要防止请求风暴。

-

断网演练:断网场景下,以合理的频率进行重试,断网结束时可以快速重连恢复。

5. 安全性

支持基础的鉴权,数据加密能力。

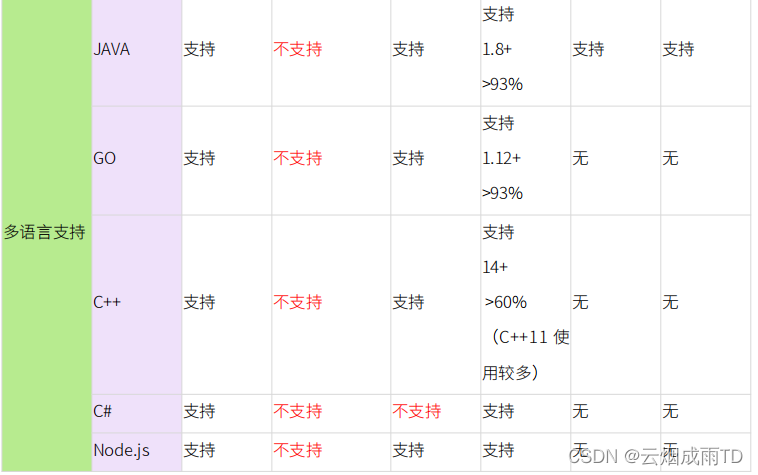

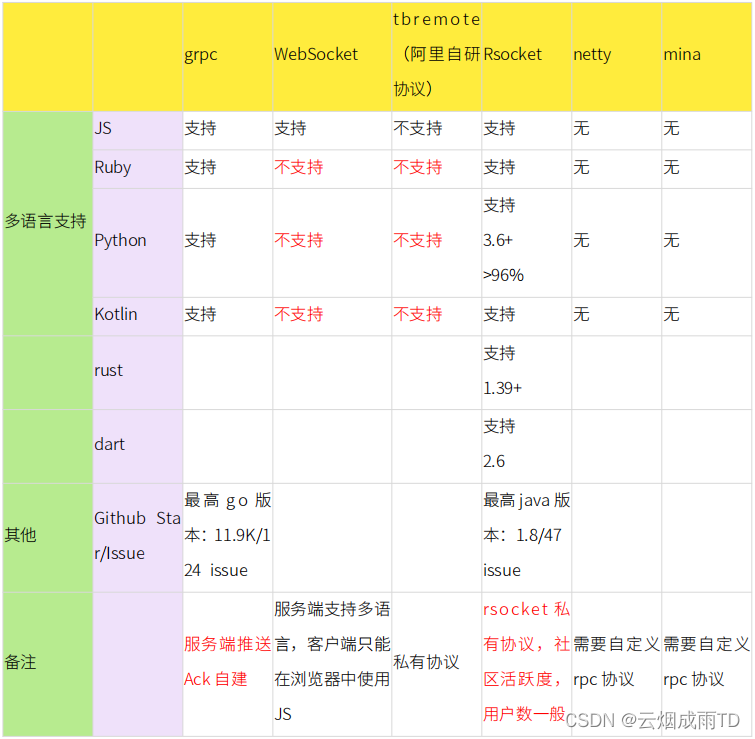

6. 低成本多语⾔实现

在客户端层面要尽可能多的支持多语言,至少要支持⼀个 Java 服务端连接通道,可以使用多个主 流语言的客户端进行访问,并且要考虑各种语言实现的成本,双边交互上要考虑 thin sdk,降低多 语言实现成本。

7. 开源社区

文档,开源社区活跃度,使用用户数等,面向未来是否有足够的支持度。

四、长链接选型对比

在当前的备选框架中,从功能的契合度上,Rsocket 比较贴切我们的功能性诉求,性能上比 grpc 要强⼀些,开源社区的活跃度上相对 grpc 要逊色很多。

参考:

- 版本分布参考:https://blog.csdn.net/sinat_33224091/article/details/105002276

- C++:https://www.jetbrains.com/zh-cn/lp/devecosystem-2020/cpp/

- JAVA https://www.jetbrains.com/zh-cn/lp/devecosystem-2020/java/

- GO:https://www.sohu.com/a/390826880_268033

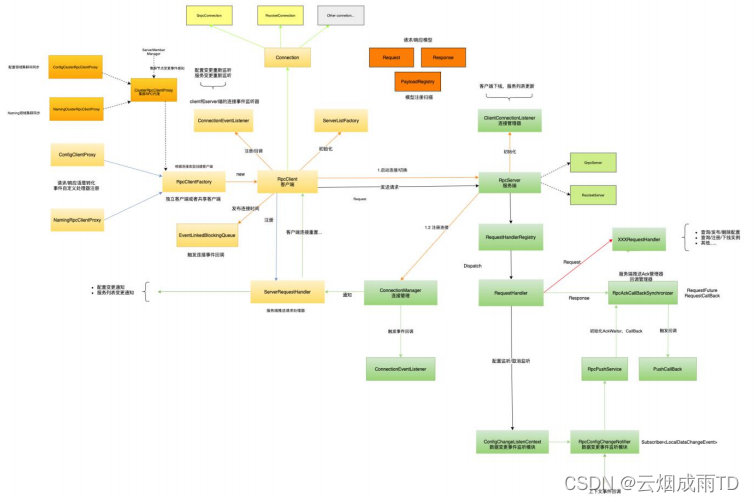

五、基于长链接的⼀致性模型

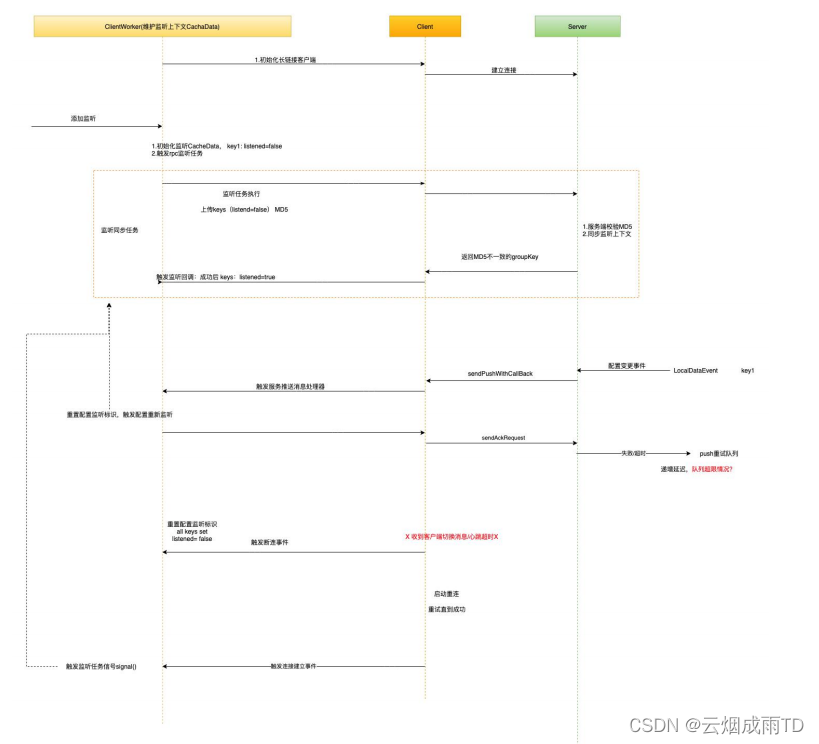

1. 配置⼀致性模型

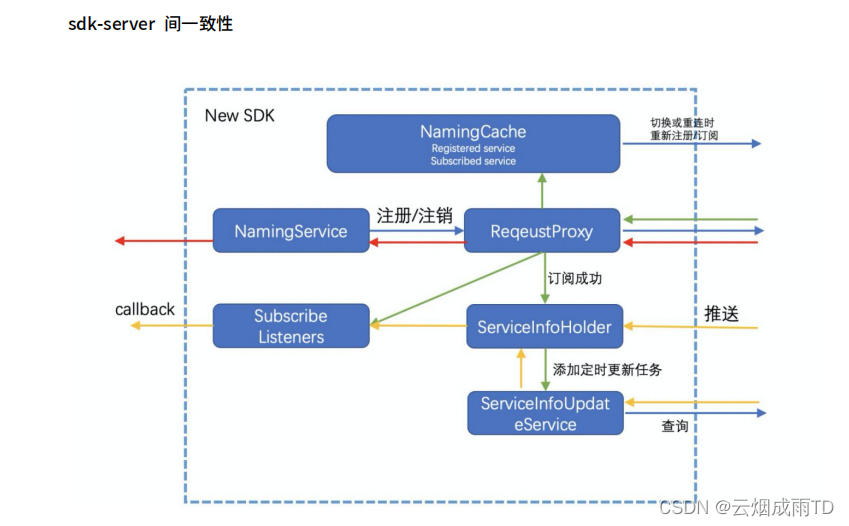

sdk-server ⼀致性

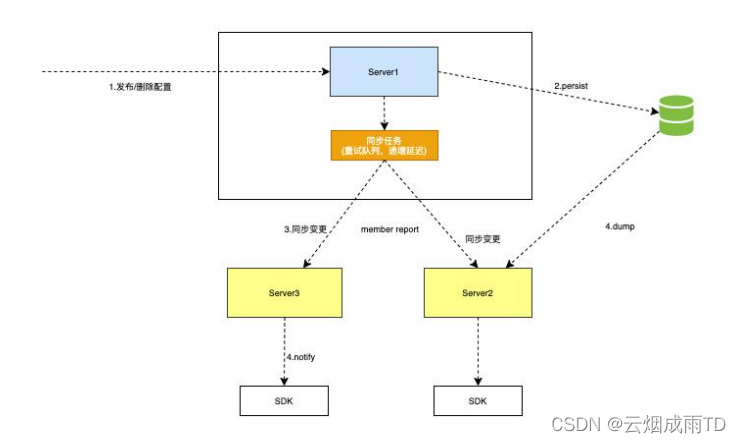

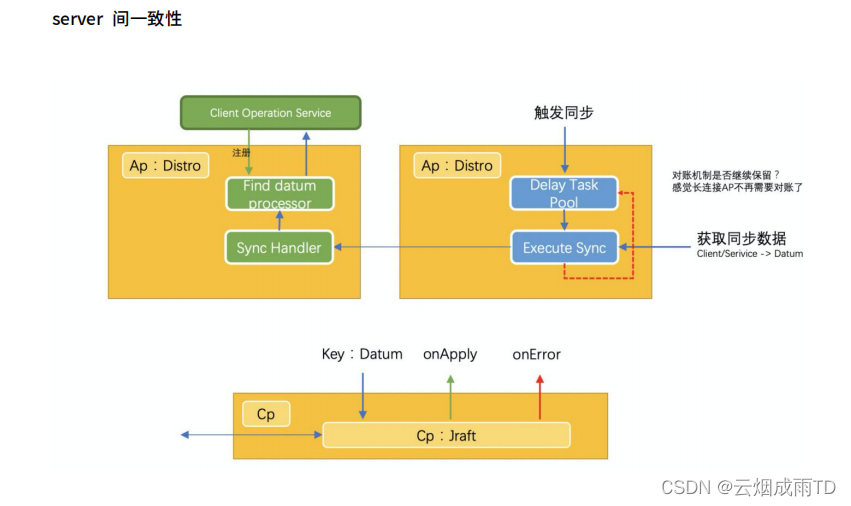

server 间⼀致性

Server 间同步消息接收处理轻量级实现,重试失败时,监控告警。

断网:断网太久,重试任务队列爆满时,无剔除策略。

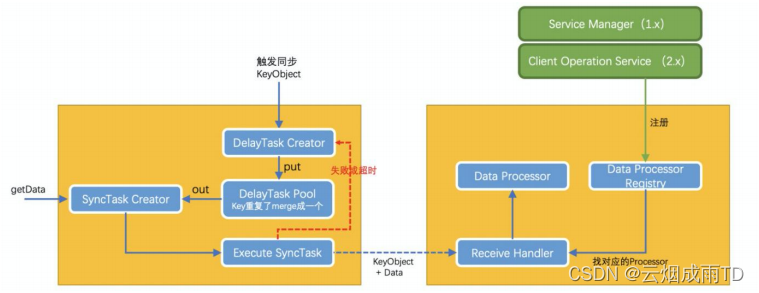

2. 服务⼀致性模型

六、核心模型组件设计

版权声明:本文不是「本站」原创文章,版权归原作者所有 | 原文地址: